Гладните за компютърна мощ модели за машинно обучение продължават да бъдат „най-горещата“ част от технологичната индустрия, а Google публикува подробности за един от своите суперкомпютри с изкуствен интелект, твърдейки, че е по-бърз и по-ефективен от конкурентните системи на Nvidia.

И докато Nvidia доминира на пазара за обучение и мобилизиране на AI модели с над 90% дял, Google проектира и мобилизира AI чипове на име Tensor Processing Units (TPU) от 2016 г.

Google е от големите пионери в областта на изкуствения интелект, а служители на компанията са разработили едни от най-важните неща в сферата през последното десетилетие.

Някои хора обаче смятат, че Google изостава по отношение на комерсиализацията на своите изобретения, а вътре в компанията има надпревара за представянето на продукти, така че да докаже, че не е пропиляла преднината си.

AI модели и продукти, като чатбота на Google - Bard, или ChatGPT на OpenAI, който използва чиповете A100 на Nvidia, изискват много компютърна мощ и стотици хиляди чипове, за да работят заедно по обучението на модели, като компютрите работят без прекъсване в продължение седмици или месеци.

Във вторник от Google обявиха, че са изградили система с над 4 000 TPU, обединени със специално изградени за случая компоненти, проектирани да работят и обучават AI.

Системата работи от 2020 г. и е използвана за обучението в период от 50 дни на модела PaLM на Google, който се конкурира с модела GPT на OpenAI.

Базираният на TPU суперкомпютър на Google, който носи името TPU v4, е “между 1.2 и 1.7 пъти по-бърз и използва между 1.3 и 1.9 пъти по-малко енергия от Nvidia A100,” пишат от Google.

“Представянето, скалируемостта и наличността превръщат суперкомпютрите TPU v4 в работните коне на големите езикови модели”, се казва още в информацията, предоставена от Google.

Резултатите на TPU-то на Google обаче не са сравнение с най-новия AI чип на Nvidia - H100, тъй като той е излязъл по-скоро и за направата му са използвани по-усъвършенствани производствени технологии.

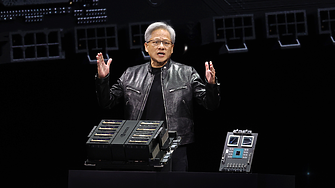

Тази седмица бяха публикувани и резултатите от тест на AI чипове на име MLperf, а главният изпълнителен директор на Nvidia Дженсън Хуанг заяви, че те показват, че най-новият чип на Nvidia (H100) е значително по-бърз от предишното поколение.

Огромните количества компютърна мощ, необходими за AI, струват скъпо, а мнозина в индустрията са са фокусирани върху разработването на нови чипове, компоненти, като оптични връзки, или софтуерни техники за намаляване на количествата компютърна мощ, която е необходима.

Нуждите от мощ на AI са добре дошли за доставчиците на облачни услуги, като Google, Microsoft и Amazon, които могат да отдават под наем компютърна мощ на час и да предоставят кредити или изчислително време на стартъп компании, с което да изграждат отношения с тях.

Новините на Darik Business Review във Facebook , Instagram , LinkedIn и Twitter !

СИСТЕМИ ЗА СЪХРАНЕНИЕ

Калкулатори

Най-ново

СИСТЕМИ ЗА СЪХРАНЕНИЕ

27.05.2026Фирма от Монтана произвежда 350 000 велосипеда годишно за цяла Европа

05.05.2026Mastercard с първи успешни тестове на трансакции с AI у нас

05.05.2026България на трето място в ЕС по евтин ток

05.05.2026За два месеца: БАБХ спря над 500 т негодни храни и 1.3 млн. яйца

05.05.2026Bulgaria Sat-1: Как SpaceX изстреля българския сателит в геостационарна орбита

05.05.2026Прочети още

Дариева: Радев бе господар на мълчанието досега!

darik.bgРадостин Василев: При Радев цари аматьорщина!

darik.bgДамянова: Подкрепа от Борисов и Пеевски за Радев е възможна за ВСС!

darik.bg3 май - Международен ден на слънцето и свободата на печата

9meseca.bg